ChatGPT之父警告AI可能灭绝人类 呼吁立法认真对待

九六城堡商城【里面商品真便宜】

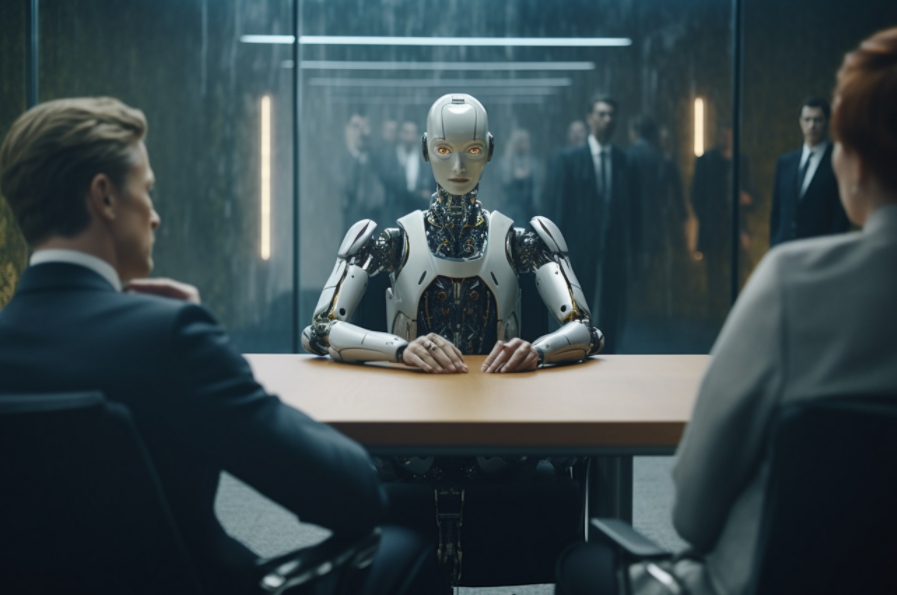

两家领先的人工智能公司的负责人再次警告说,先进的人工智能构成了生存威胁。DeepMind和OpenAI首席执行官Demis Hassabis和Sam Altman承诺支持AI安全中心发布的一份简短声明,该声明声称监管机构和立法者应该更加认真地对待“严重风险”。

“减轻人工智能灭绝的风险应该与流行病和核战争等其他社会规模风险一起成为全球优先事项,”声明中写道。

人工智能安全中心是一家总部位于旧金山的非营利组织,旨在“减少人工智能的社会规模风险”,声称在战争中使用人工智能可能“极其有害”,因为它可用于开发新的化学武器和加强空战。

这份简短声明的签署者没有澄清他们认为可能灭绝的内容,还包括该领域的商业和学术领袖。

其中包括被称为“人工智能教父”的Geoffrey Hinton,以及ChatGPT开发商OpenAI的首席执行官兼联合创始人Ilya Sutskever。这份名单还包括谷歌等公司的数十名高级管理层,Skype的联合创始人,以及人工智能公司Anthropic的创始人。

在几家公司发布新工具后,人工智能现在已进入全球意识,允许用户通过询问他们想要的东西来生成文本、图像甚至计算机代码。专家表示,这项技术可能会取代人类的工作,但这一声明警告了更深层次的担忧。

ChatGPT和Dall-E等工具的出现再次引发了人们的担忧,即如果人工智能通过人类智能,它有一天可能会消灭人类。

今年早些时候,技术领导者呼吁领先的人工智能公司暂停其系统的开发六个月,以研究降低风险的方法。

“具有人类竞争智能的人工智能系统可能对社会和人类构成深远的风险,”生命未来研究所的公开信说。“人工智能研究和开发应该重新专注于使当今强大、最先进的系统更加准确、安全、可解释、透明、稳健、一致、值得信赖和忠诚。

八字精批2025运势命中贵人八字合婚