Stability AI新开源LLM项目“FreeWilly”表现优于 Meta 的 Llama 2

Stability AI 与 CarperAI 发布了两个新的大型语言模型,名为 FreeWilly。其中一个模型基于 Meta 的 Llama v2,通过优化性能展示了开源开发的速度。

两个 FreeWilly 模型均基于 Meta 的 Llama 模型,其中 FreeWilly2已使用具有700亿个参数的较新的 Llama-2模型。FreeWilly 团队自己的努力是使用“高质量指令”生成的新合成数据集进行“仔细微调”。

FreeWilly 团队使用微软的 “Orca 方法” 训练小型模型逐步推理,而不是简单地模仿大型模型的输出风格。他们创建了一个包含600,000个数据点的数据集,相比于 Orca 团队使用的数据集只占了10% 左右。

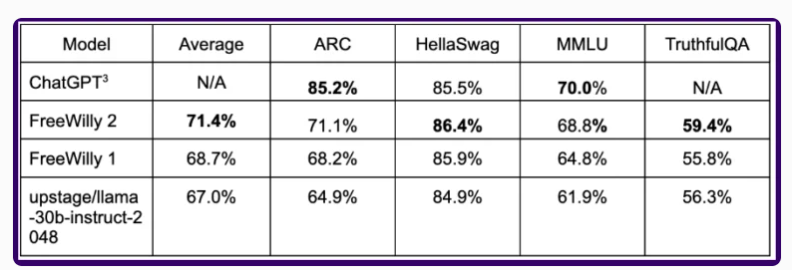

在常见的基准测试中,以这种方式训练的 FreeWilly 模型在某些逻辑任务中表现出与 ChatGPT 相当的结果,其中基于 Llama2的 FreeWilly2模型优于 FreeWilly1。

总体而言,FreeWilly2在性能上领先于 Llama v2约4%,这表明 Meta 的新标准模型仍有改进的空间,并且开源社区可以提供帮助。

FreeWilly2目前在性能最佳的开源模型列表中处于领先地位,而原始的 Llama2在通用语言理解基准测试 MMLU 上略微领先。

FreeWilly 模型在开放访问大型语言模型领域树立了新标准,推动了研究并增强了自然语言理解和复杂任务的实现。这些模型可免费用于研究目的,并且 FreeWilly2被认为是在基准测试中具有最佳平均结果的开源模型。

项目网址:https://huggingface.co/spaces/HuggingFaceH4/open_llm_leaderboard